El Ferrari en el Pantano: Por Qué los Modelos de Frontera Sin Infraestructura Son Dinero Tirado

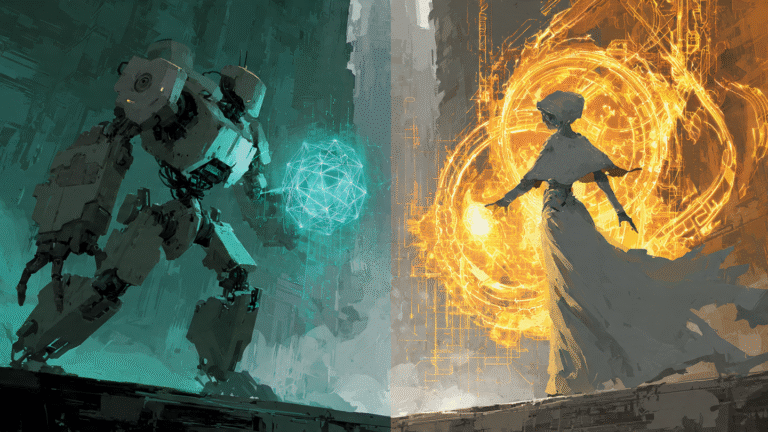

Tener un modelo de lenguaje de frontera en pleno 2026 es como poseer un Ferrari en medio de un pantano: el motor es una obra maestra de la ingeniería, tiene una potencia bruta capaz de dejarte sin aliento, pero si no tienes una carretera pavimentada, solo terminarás hundido en el lodo mientras el motor ruge inútilmente. Ese «pantano» es lo que en la industria llamamos el «último tramo de los agentes de IA». Es ese espacio tortuoso y lleno de fricción donde una Demo brillante que dejó a todos boquiabiertos en la junta de dirección se estrella contra la realidad de la infraestructura, la latencia, la gestión de memoria y la seguridad empresarial.

La mayoría de las organizaciones han pasado la fase de «jugar con el chat». Ya saben que la IA puede escribir correos o resumir PDFs. El problema real, el que quita el sueño a un CTO o a un Director de Operaciones, es la escalabilidad operativa. Construir un agente que «funcione» es fácil; construir un agente que sea fiable, seguro y mantenible en producción sin tener que contratar a un ejército de ingenieros de infraestructura es el verdadero desafío. Hasta ahora, el camino era el «DIY» (Hazlo tú mismo): escribir miles de líneas de código de orquestación, pelearse con la persistencia de los estados y rezar para que la API no alucinara en el paso cinco de un flujo crítico.

Aquí es donde entra el «Capitán del Puerto». AWS no ha llegado a la fiesta solo para traer los snacks; ha llegado para pavimentar el pantano. Con una inversión estratégica de 50.000 millones de dólares en OpenAI, Amazon no solo está comprando capacidad, está integrando el cerebro más avanzado del mercado en el sistema nervioso más robusto de la nube. Al abrir los modelos frontier de OpenAI en Amazon Bedrock, AWS está haciendo algo disruptivo: está eliminando la necesidad de que tú construyas la carretera. Te están entregando el asfalto listo, las señales de tráfico puestas y el peaje ya pagado.

El Fin del Monopolio del Orquestador: De Código Infinito a Tres Llamadas API

Durante mucho tiempo, la arquitectura de un agente de IA parecía un plato de espaguetis: el modelo llamaba a una función, la función devolvía un error, el orquestador intentaba corregirlo, y todo esto mientras intentabas que el agente recordara que el cliente odia el color azul. Era un caos de código personalizado que hacía que cualquier cambio en el modelo implicara reescribir la mitad de la aplicación.

El cambio de paradigma que propone Amazon Bedrock Managed Agents es, básicamente, pasar de ser un arquitecto de tuberías a ser un director de orquesta. En lugar de programar la lógica de «si pasa A, entonces haz B y guarda C en la base de datos», ahora configuras el comportamiento. La magia reside en AgentCore y el framework Strands Agents.

¿Qué significa esto en lenguaje humano? Que la complejidad de implementar un agente en producción se ha reducido a tres llamadas API. Ya no tienes que gestionar la infraestructura subyacente, ni pelearte con el despliegue de contenedores para cada habilidad del agente. AWS se encarga de la «fontanería». Tú solo defines:

- El modelo que quieres usar (en este caso, el poder bruto de OpenAI).

- Las herramientas que el agente puede tocar (Tus APIs, tus bases de datos, tu CRM).

- Las instrucciones de negocio (El «cómo» debe comportarse y qué límites no puede cruzar).

La pieza secreta de este rompecabezas es el Stateful Runtime Environment. Para los que no hablan «nube», esto es simplemente la capacidad del agente de tener una memoria coherente y un estado persistente sin que tú tengas que montar una base de datos de vectores compleja y gestionarla manualmente. Es la diferencia entre hablar con alguien que tiene amnesia cada cinco minutos y hablar con un colaborador que recuerda exactamente en qué punto de la negociación se quedaron hace tres días. Para un C-Level, esto se traduce en una sola palabra: ROI. Menos tiempo de desarrollo significa un tiempo de llegada al mercado (Time-to-Market) drásticamente reducido y una mitigación de riesgos operativa casi total.

El Playbook del Agente Imbatible: De la Idea a la Producción en Tres Actos

Si ya superaste la fase de descubrimiento y quieres dejar de hacer «experimentos» para empezar a generar valor medible, necesitas un abordaje pragmático. Olvida los manuales de 200 páginas. Para implementar un Agente Administrado en Bedrock con la potencia de OpenAI, vamos a aplicar un pensamiento «fuera de la caja» basado en la configuración sobre la programación.

Aquí tienes la guía profesional para desplegar tu primer agente de grado empresarial sin morir en el intento:

Acto I: El Diseño del Ecosistema (El «Cuerpo» del Agente)

No empieces por el prompt. Empieza por los límites. Define un entorno de cómputo y almacenamiento donde el agente tenga «permisos de lectura y escritura» estrictamente controlados.

- Tip de Arquitecto: No le des al agente acceso total a tu base de datos. Crea una capa de «Micro-Herramientas» (APIs específicas). En lugar de «Acceso a SQL», dale «Herramienta para consultar saldo de cliente». Esto reduce las alucinaciones y evita que la IA decida, por error, borrar la tabla de usuarios.

Acto II: La Configuración del Runtime (El «Cerebro» y la «Memoria»)

Aquí es donde configuras el Stateful Runtime Environment. No escribas instrucciones genéricas como «Sé un asistente útil». Usa un marco de Identidad, Restricción y Objetivo.

Estructura de Instrucción Profesional:

- Identidad: «Eres el Especialista en Optimización de Cadena de Suministro de [Empresa], con autoridad para analizar inventarios en tiempo real».

- Restricción: «No puedes autorizar compras superiores a 10.000 USD sin una validación humana vía API de Slack».

- Objetivo: «Tu meta es reducir el exceso de stock en un 15% mediante la redistribución inteligente entre nodos».

Habilidades: Vincula las herramientas creadas en el Acto I. Bedrock Managed Agents se encarga de decidir cuál usar y en qué orden.

Acto III: El Ciclo de Ejecución y Streaming (La «Voz» del Agente)

Configura la transmisión de resultados en tiempo real. En entornos empresariales, esperar 30 segundos a que un agente piense toda la respuesta es un suicidio de experiencia de usuario (UX). Implementa la salida en streaming para que el usuario vea el razonamiento del agente mientras ocurre.

- Validación de Seguridad: Activa los controles de gobernanza unificada de Bedrock. Esto permite que, independientemente de si el agente usa un modelo de OpenAI, Anthropic o Meta, las reglas de seguridad y el filtrado de datos sensibles sean los mismos. Es tu «escudo protector» corporativo.

El Mapa de Decisión para el Líder Tecnológico (Quick-Guide)

| Si tu problema es… | La solución técnica es… | El resultado de negocio es… |

|---|---|---|

| «Mis agentes son lentos y olvidan el contexto» | Stateful Runtime Environment | Mayor retención de clientes y flujos más fluidos. |

| «Tardaríamos meses en programar la orquestación» | AgentCore / Strands Agents | Reducción del ciclo de despliegue de meses a días. |

| «Me aterra que la IA acceda a datos sensibles» | Bedrock Unified Governance | Cumplimiento normativo (Compliance) garantizado. |

| «No quiero depender de un solo proveedor de modelos» | Multi-model Hub de Bedrock | Agilidad estratégica y eliminación del Vendor Lock-in. |

Más allá del Hype: El Horizonte de la Autonomía

Estamos entrando en una era donde la diferencia entre una empresa líder y una obsoleta no será quién tiene la IA más potente —porque los modelos frontera se están volviendo un commodity que cualquiera puede alquilar por API— sino quién tiene la mejor infraestructura para operarlos.

La jugada de AWS con OpenAI es un mensaje claro: la inteligencia es el motor, pero la nube es el chasis. De nada sirve tener el motor más potente del mundo si el chasis se desarma a los 100 km/h. Al integrar la capacidad de OpenAI con la robustez de Bedrock, estamos pasando de la era de los «Chatbots» a la era de los «Sistemas Agénticos Autónomos». Estos sistemas no solo responden preguntas; ejecutan procesos, toman decisiones basadas en datos reales y, lo más importante, lo hacen dentro de un marco de seguridad que permite a un Director de IT dormir tranquilo por la noche.

El verdadero tesoro aquí no es el modelo de lenguaje en sí, sino la capacidad de escalar esa inteligencia sin que la complejidad técnica se convierta en un impuesto que consuma todo tu presupuesto de innovación. La infraestructura ya no es el obstáculo; es la ventaja competitiva.

Ahora, la pregunta es para ti, que estás liderando la transformación de tu organización: ¿Estás construyendo una colección de demos brillantes que viven en un laboratorio, o estás diseñando el sistema operativo agéntico que realmente moverá la aguja de tus resultados operativos este año? El pantano sigue ahí, pero ahora tienes el asfalto. ¿Vas a seguir caminando o vas a pisar el acelerador?